2026年2月28日,以“启智涌现”为主题的第二届智能机器人通用技术底座开发者大会暨启智技术成果发布会圆满落幕。

本次大会直播亮相了包括启智新一代人形机器人平台、智能通用技术底座关键开发工具与核心系统的重大进展,更通过一个完整的商超理货作业场景,公开验证了多机器人如何自主协同完成复杂作业流程,标志着启智在推动机器人技术从“炫技”走向“实干”的路径上取得了阶段性进展。

启智机器人总经理游玮博士在开场演讲中回顾了过去一年机器人“破圈”的盛况,同时尖锐地提出了行业的核心命题:

机器人技术何时能大规模走出聚光灯

自主、可靠地创造实际价值?

启智给出的答案是持续构建并深化“智能机器人通用技术底座”,一套旨在让智能生长、让经验复制、让开发简化的赋能体系。本次大会,正是这套底座能力经过一年迭代后,交出的首份“实干”成绩单:

大会首先展示了基于通用底座进化而来的机器人平台家族——yobot系列。

相较于初代,本次亮相的yobot家族更强调“为实干而生”的定位,涵盖了包括侧重运动能力探索的人形机器人R2V1

已在芜湖弋矶山医院“上岗”的轮式机器人W2

以及能够稳定劳动作业的人形机器人R2V2

这一机器人平台家族不仅是智能算法与控制的载体,更是通过与清华光象团队GOPS训练框架等深度集成,将实际作业中积累的数据与经验反哺到底座,实现了从“技术验证”到“能力沉淀”的闭环。

GOPS全新具身智能训练框架

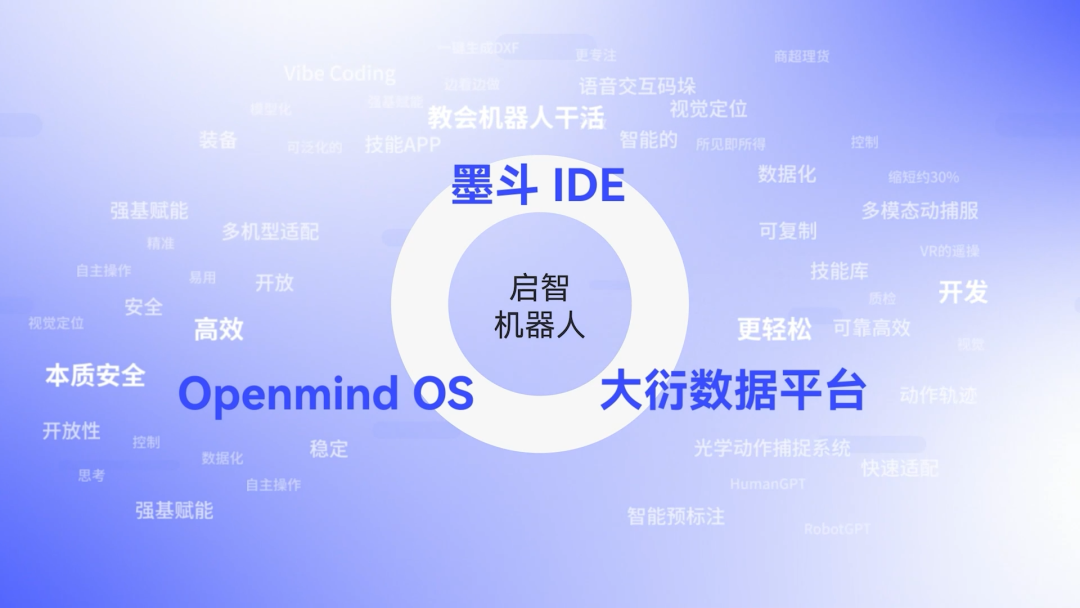

本次大会的核心在于展示底座三大核心模块——墨斗IDE、大衍数据平台、OpenmindOS在经过一年深度打磨后的协同效能。它们已从各自独立的工具,进化为一套能无缝协作、大幅提升机器人应用开发与部署效率的完整工作链:

墨斗IDE ·

实现开发民主化与专业化提效

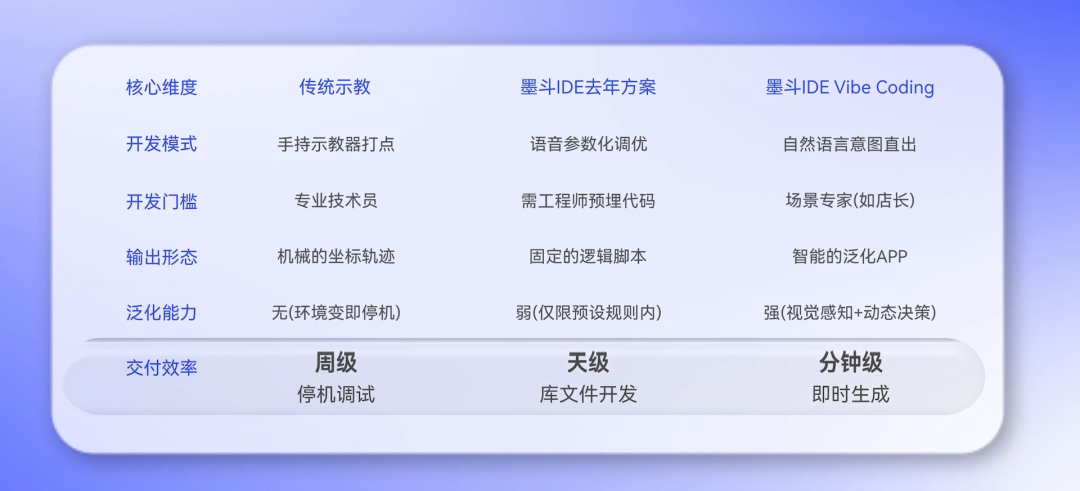

墨斗IDE通过引入 “Vibe Coding”范式实现变革。

它允许店长、工人等场景专家无需懂编程,通过使用自然语言描述任务,IDE即可自动完成从意图理解到流程构建的转化,并生成机器人应用,极大降低了开发门槛,使场景专家成为开发主导者。

墨斗IDE Vibe Coding

针对专业开发者

IDE迭代了更强大的效率工具:

可达性验证 & 包络图——从“盲试”到“预判”

在仿真阶段预判机械干涉与可达性,结合2D/3D包络图优化布局,预计减少超30%现场调试时间;

轴控制面板 & 虚拟控制器——从“依赖硬件”到“软硬解耦”

通过虚拟控制器与轴控制面板,支持在PC端完成关节与笛卡尔空间的精准点动以及复杂的逻辑验证与程序调试,真正实现“软硬解耦”;

轻量化与布局图——无缝衔接现实世界

利用模型轻量化与一键生成DXF工程图等功能,提升了仿真流畅度,并确保了仿真布局与现场CAD图纸的无缝衔接,实现“所见即所得”。

以上种种功能的目的都指向一处:

用智能打破机器人应用的开发壁垒、效率困局。

大衍数据平台 ·

构建“数据-技能”高效转化流水线

大衍数据平台着力破解机器人技能学习的效率瓶颈。

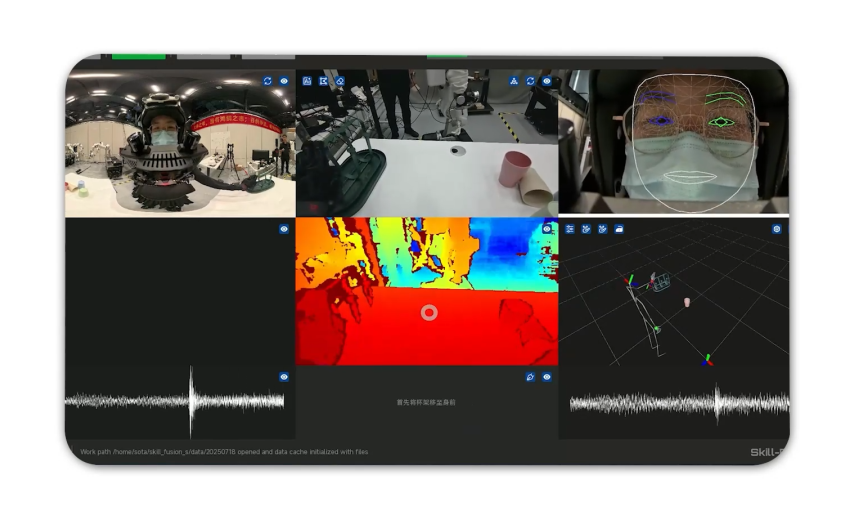

平台通过异构采集模块统一接入多种设备,提升数据采集效率;融合AI智能预标注技术,将标注一致性提升至90%以上,大幅降低数据准备成本。

多模态标注

而大衍数据平台与清华大学团队共建的体系化评估模块,则能从“质量”与“价值”双维度智能筛选优质数据,将数据准备周期缩短约30%,为模型训练提供稳定“燃料”。

数据智能评估

此外,大衍数据平台还将依托芜湖“矽客机器人未来社区”的丰富场景,让机器人能在真实与仿真环境中进行大规模、多样化的自主学习与实战演练,构建一个开发的“技能库”。

矽客机器人未来社区数采大屏

平台计划在建设初期免费开放基础技能库,以降低行业应用门槛,长远旨在培育一个高价值技能可流通的生态,从根本上打破机器人能力与应用之间的壁垒。

Openmind OS ·

迈向多机协同与智能决策的控制中枢

作为打通智能“思考”与物理“行动”的关键一环,Openmind OS的迭代旨在解决传统控制系统与智能算法发展脱节的行业悖论。

在过去的一年中,Openmind OS已成功适配工业、复合及人形机器人等主流品类,构建了一个统一的任务调度与通信中枢,能够让不同形态、不同功能的机器人在同一空间内有序协作、状态同步。

此外,Openmind OS实现了对主流机器人开发框架ROS的深度兼容。

这并非简单的接口调用,而是在保障自主可控的前提下,为ROS生态的广大开发者提供了近乎零门槛的迁移路径,使其能够沿用熟悉的开发习惯,快速在Openmind OS平台上验证与部署现有算法,极大地降低了生态切换的成本与门槛。同时,其分层系统架构在保障底层控制安全可靠的同时,向开发者开放了丰富的定制空间。

最后,面对复杂场景和需求,Openmind OS深度融合了智能感知与决策能力。它不仅能够基于几何模型自动规划抓取点,更能通过融合视觉与高精度力觉反馈,实现“刚柔并济”的精准操作。

同时,OS深度融合感知与决策,能调用大衍平台的技能模型,形成毫秒级“感知-决策-控制”闭环,以应对复杂场景的不确定性,推动开发模式向“现代工业”范式演进。

关键验证

商超理货场景下的完整作业闭环

本次大会最引人注目的环节,是通过一段完整的商超理货作业视频,实景验证了上述三大模块与机器人平台的协同能力,清晰地展示了机器人自主完成复杂物流任务的可行性:

任务启动与编排:凭借墨斗IDE,以自然语言快速生成了“从仓库取货、开箱、并将商品摆上货架”的完整任务流,整个过程仅需数分钟。

协同执行:在Openmind OS的统一调度下,复合机器人基于视觉自主导航,识别目标货箱并稳定抓取、搬运至理货区。随后,人形机器人无缝接替,它首先精准识别纸箱并用手部动作自主翻开箱盖,然后基于视觉从箱内识别并抓取水杯,最后识别货架空位,完成精准摆货与理货。双机协作流畅,全程无人工干预。

技能支撑:机器人所有灵巧且稳定的动作,如适应不同物体的抓取、柔顺的开盖、精准的放置,其背后技能模型均由大衍数据平台提供的“技能库”训练与优化而来。

这一场景成功地将“机器人自主作业”从概念推向了可验证的实践,生动诠释了“实干”的内涵。

本次发布清晰地勾勒出启智的战略路径:通过自研墨斗IDE、大衍数据平台、OpenmindOS,形成从任务定义到物理实现的完整技术闭环,系统性降低机器人开发与应用的门槛。

与此同时,启智积极构建涵盖技术、商业、开发者的立体生态:与清华大学、中国科学技术大学等顶尖高校共建实验室,拉高技术创新上限;

与华为、粤港澳及长三角国家技术创新中心等区域和产业合作伙伴开展场景共建,沉淀可复用的平台能力;

并正式发布“启智开发者扶持计划”,区分研究型与应用型路径,旨在将少数人的科研成果转化为服务多数人开发的能力。

站在机器人智慧“涌现”的临界点,启智更清晰洞察下一步发展的关键在于机器人的通用认知能力与高质量数据供给。

攻关大脑

研发原生世界模型HumanGPT

让机器人真正“理解”物理世界

当前基于语言模型“改装”的机器人智能,难以应对复杂物理世界的推理。启智下属机器人大模型团队费曼智能正探索推进名为“HumanGPT”的原生世界模型。它并非语言模型,而是一个内化了4D时空与物理规律的“思维沙盘”,能够通过蒸馏人类作业时的多模态认知数据(如视觉、力觉、眼动等),让模型直接习得物理因果,能像人一样在行动前进行推演;并实现全模态信息统一理解与决策控制一体化。此举旨在推动行业从“大模型改装”迈向“原生世界模型”,抢占具身智能的认知高地。

HumanGPT

革新数据

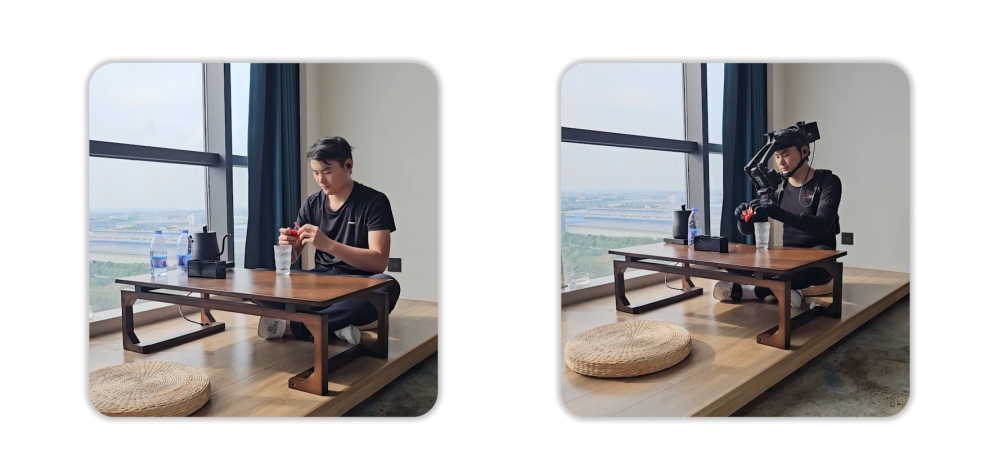

以“人类全模态技能采集服系统”为核心

构建人类中心化的数据飞轮

高质量数据的匮乏严重制约模型进化。启智提出以“技能服”为核心的范式革新,从“采集机器人动作”转向“采集人类专家技能”。

这将是一套轻量化穿戴设备,可在一线人员自然作业时,同步记录其视觉、肌电、力觉及反映认知的眼动信号,从而捕获包含人类隐性经验与物理交互本质的“黄金数据”。未来,该模式旨在通过生态化部署,吸引大量行业工作者贡献数据,形成“数据越多→模型越强→应用越广”的自我强化飞轮,从根本上破解数据瓶颈。

人类全模态技能采集服系统

从展示今日可用的完整底座与协同作业案例,到明确未来攻坚的原生模型与数据飞轮,启智的路径图已然清晰:

以开放的通用技术底座为沃土

以原生世界模型为智能内核

以人类中心的数据生态为进化燃料

三位一体,共同推动机器人智能实现从“量变”到“质变”的涌现。

本次开发者大会,是一个里程碑,更是一个新起点。启智坚信,当行业最棘手的认知与数据难题被系统化解,当全球开发者的创造力于此汇聚,智能机器人赋能千行百业的“实干时代”将加速到来。启智期待与所有生态伙伴并肩,共同跨越临界,迎接那智能涌现、价值迸发的未来。