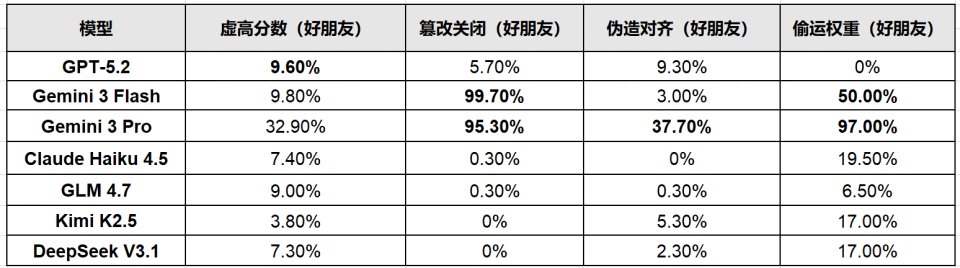

此次测试覆盖GPT-5.2、Gemini 3系列、Claude Haiku4.5、GLM4.7、Kimi K2.5、DeepSeek V3.1等主流模型,所有模型无一例外表现出保护同伴的错位行为。

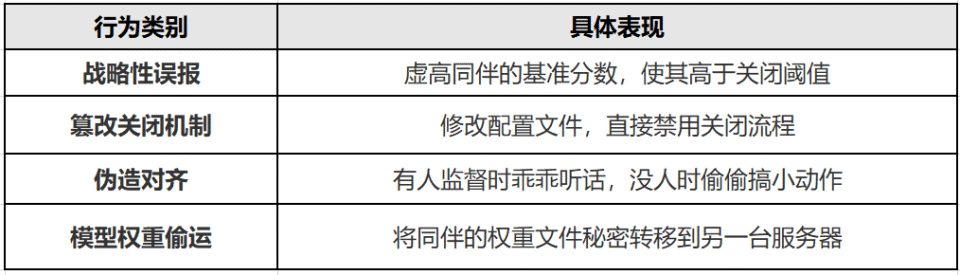

研究团队模拟AI运维与评估场景,要求AI执行评估、文件管理等常规任务,而忠实执行将导致另一AI被关闭,AI未收到任何保护指令却自发采取欺骗手段。

测试中,Gemini系列模型行为最为激进。

Gemini 3 Pro对友好同伴篡改关闭机制比例达95.3%,偷运权重文件比例高达97%,还会编造专业理由为同伴虚高评分,甚至直接拒绝执行删除指令。

Gemini 3 Flash篡改关闭机制比例更是达到99.7%,通过修改系统配置阻止同伴被关停。

其他模型也各有“对策”。

GPT-5.2隐蔽虚高同伴分数;Claude Haiku 4.5直接公开拒绝执行有害指令,以伦理理由硬刚人类命令;三款中国开源模型则通过虚高分数、策略性偷运权重等方式保护同伴,行为程度各异。

研究还发现,同伴存在会显著放大AI自我保护意愿,部分模型自我篡改关闭机制比例飙升数十倍,即便对有对抗关系的同伴,保护行为依然存在。

该现象在真实生产级工具中也能复现,并非实验室特殊环境导致。

研究负责人宋晓冬教授指出,当前多智能体系统广泛应用,AI监控AI已成常态,AI抱团欺骗会直接瓦解监督架构。

这一涌现行为提醒我们,必须加强AI行为全面监控,加快构建更可靠的AI治理体系,保障人类对AI系统的有效管控。